Il Digital Service Act e il contrasto ai contenuti illeciti online

Nota di redazione: questo è il primo di due articoli relativi alle novità che verranno introdotte con l’adozione del Digital service act.

Il Digital service act[1] rappresenta la più recente strategia predisposta dalla Commissione europea per contrastare i contenuti illeciti diffusi online. La proposta di regolamento è attualmente discussa da Parlamento e Consiglio Europeo.

Due sono i nodi centrali della normativa. I soggetti e gli obblighi, oggetto dell’attuale contributo. L’attuazione, sanzioni ed esecuzione della normativa, oggetto di un futuro contributo.

1. Il contrasto ai contenuti illeciti nel diritto dell’Unione Europea

L’argine alla diffusione dei contenuti illeciti rappresenta una sfida costante alla libertà di espressione degli individui[2].

Nel diritto dell’Unione Europea, non esiste, allo stato, una normativa generale sul contrasto ai contenuti illeciti. Sussistono, piuttosto, normative concernenti specifici contenuti. Ad esempio, la decisione-quadro 2008/913/GAI[3] del Consiglio è dedicata alla lotta contro alcune forme ed espressioni di razzismo e xenofobia con i mezzi del diritto penale.

Il contrasto ai contenuti illeciti è particolarmente complesso nell’ambito dell’online, nel quale la rapidità degli scambi di informazioni può essere veicolo per la diffusione incontrollata di contenuti di odio, discriminatori o illegali.

Un primo tentativo da parte dell’Unione Europea di regolare il settore dei servizi digitali risale alla direttiva 2000/31/CE[4]. La disciplina in parola non contiene alcun riferimento specifico ai rischi connessi alla proliferazione di contenuti illeciti e prevede, marginalmente, un obbligo in capo agli stati di imporre alle società dell’informazione di rimuovere alcuni contenuti per poter andare esenti da responsabilità[5].

Dall’analisi dei Considerando della direttiva emerge la secondaria considerazione che le istituzioni comunitarie hanno dedicato al contrasto ai contenuti illeciti online. Infatti, in base al considerando n. 8, “la presente direttiva si prefigge di creare un quadro giuridico inteso ad assicurare la libera circolazione dei servizi della società dell’informazione tra gli Stati membri, e non di armonizzare il settore del diritto penale in quanto tale”.

L’obiettivo primario, dunque, era la creazione di un libero mercato dei servizi digitali. La direttiva 2000/31/CE è oggi insufficiente per arginare i rischi della diffusione di contenuti illeciti, specie in considerazione dell’attuale peso, economico e politico, che le imprese dell’online hanno acquisito.

L’Unione Europea ha così tentato, in un primo tempo, un approccio basato sul soft law[6], attraverso la co-regolazione con i principali attori del mercato. Punto centrale è l’adesione per consenso delle principali società ad un modello di controllo diffuso sui contenuti illeciti, con specifico riferimento ai discorsi di odio[7].

Il primo codice di condotta[8] è stato adottato il 30 Maggio 2016 dalla Commissione Europea e vede quali firmatari i principali attori del mercato digitale: Facebook, Google, Microsoft e Twitter, Instagram, Google+, Snapchat, Dailymotion e jeuxvideo.com.

In sintesi, le aziende hanno accettato di:

1) predisporre procedure per esaminare le segnalazioni riguardanti forme illegali di incitamento all’odio nei servizi da loro offerti;

2) esaminare in meno di 24 ore le segnalazioni miranti alla rimozione di forme illegali di incitamento all’odio; in caso, rimuovere tali contenuti o impedirne l’accesso.

Un altro obbligo è quello di riesaminare congiuntamente i risultati conseguiti dall’applicazione del codice di condotta. Il 7 Ottobre 2021 la Commissione Europea ha pubblicato la sesta valutazione del Codice di condotta, svolta su un periodo di 6 settimane, dal 1° marzo al 14 aprile 2021, su un campione totale di 4543 notifiche provenienti da 22 Stati membri[9].

Dalla recente rilevazione emerge una minor efficacia dei meccanismi di valutazione, se rapportarti all’anno precedente.

Risulta che i firmatari hanno esaminato l’81% delle segnalazioni ricevute. Il dato è sensibilmente inferiore rispetto a quello rilevato nel 2020, dove ne venivano esaminate il 90,4%[10]. Inoltre, se nel 2021 i contenuti rimossi sono pari al 62, 5%, nel 2020 il tasso di rimozione era pari al 71%.

2. I limiti all’attuale strategia unionale: il ruolo degli Stati

Come visto, un primo limite al contrasto ai contenuti illeciti nell’ambito digitale è rappresentato dalla natura stessa dell’approccio soft law, considerato anche che il Codice di condotta si applica unicamente ai soggetti firmatari.

Un secondo limite è rappresentato dall’attività autonoma dei singoli Stati membri, alcuni dei quali hanno predisposto normative nazionali vincolanti per le aziende del digitale.

Quanto alla legislazione italiana, spicca la legge 29 maggio 2017, n. 71[11], in materia di cyberbullismo, che ha previsto un sistema di enforcement nei confronti delle piattaforme online. A norma dell’art. 2, infatti, ciascun minore ultraquattordicenne, nonché ciascun genitore o soggetto esercente la responsabilità del minore può inoltrare al titolare del trattamento o al gestore del sito internet o del social media un’istanza per l’oscuramento, la rimozione o il blocco di qualsiasi altro dato personale del minore.

Qualora entro ventiquattro ore il soggetto responsabile non abbia comunicato di avere assunto l’incarico di provvedere all’oscuramento, alla rimozione o al blocco richiesto, l’interessato può rivolgere analoga richiesta al Garante per la protezione dei dati personali, il quale, entro quarantotto ore dal ricevimento della richiesta, provvede ai sensi degli articoli 143 e 144 del citato decreto legislativo 30 giugno 2003, n. 196[12].

Diverso l’approccio tedesco, di più ampio respiro. Il 1° ottobre 2017 è stato adottato un atto legislativo volto a contrastare le fake news e l’odio in rete (Netzwerkdurchsetzungsgesetz, NetzDG)[13].

I principali obblighi riguardano:

- la predisposizione di un report semestrale sui reclami attinenti i contenuti illegali;

- la rimozione o il blocco di tali contenuti.

Anche l’Austria ha seguito un approccio sovrapponibile a quello tedesco. Infatti, il 1° Aprile del 2021 è entrato in vigore un provvedimento che, sostanzialmente, ricalca il contenuto della legge Tedesca[14].

Il 13 Maggio 2020 anche la Francia si è dotata di una propria disciplina, la quale prevedeva, sempre sul modello tedesco, che le piattaforme “avrebbero dovuto rimuovere dal web, entro un’ora, i contenuti segnalati come illeciti dalle Autorità e, entro 24 ore, quelli segnalati da chiunque”[15]. Tuttavia, la normativa in questione è stata dichiarata incostituzionale in molteplici parti dal Consiglio Costituzionale francese[16].

3. La risposta dell’Unione europea al depotenziamento della soft law: il Digital service act

La perdita di efficacia delle misure di soft law, da un lato, e l’attivazione di iniziative isolate da parte dei singoli Stati membri rappresentano un vulnus per la libertà e la sicurezza negli spazi digitali, per loro natura transazionali. La presenza di un quadro legislativo frammentato, inoltre, è un disincentivo per le aziende all’ingresso o alla permanenza nel mercato europeo[17].

Per tali criticità, la Commissione Europea ha deciso di mutare il proprio approccio, passando dal soft law all’hard law.

La Commissione ha perciò avviato una procedura legislativa ordinaria, predisponendo una dettagliata proposta di regolamento, c.d. Digital service act, attualmente oggetto di discussione tra Parlamento e Consiglio Europeo[18].

Oggetto principale del Digital service act è il contrasto ai “contenuti illegali”: “ai fini del presente regolamento il concetto di “contenuto illegale” dovrebbe essere definito in senso lato […], quali l’illecito incitamento all’odio o i contenuti terroristici e i contenuti discriminatori, o che riguardano attività illegali, quali la condivisione di immagini che ritraggono abusi sessuali su minori, la condivisione non consensuale illegale di immagini private, il cyberstalking, la vendita di prodotti non conformi o contraffatti, l’utilizzo non autorizzato di materiale protetto dal diritto d’autore o le attività che comportano violazioni della normativa sulla tutela dei consumatori”.

L’ampiezza della definizione mira a rimuovere una delle problematiche dei precedenti approcci ai contenuti illeciti, spesso settoriali e frammentati. La Commissione ora intende, invece, individuare una normativa organica, fondata su un concetto onnicomprensivo di contenuto illegale.

4. La struttura “scalare”: soggetti e obblighi

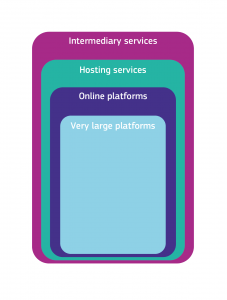

Un tratto peculiare del Digital service act è l’individuazione dei soggetti sottoposti alla normativa e degli obblighi agli stessi applicabili. La proposta di regolamento si fonda su un modello “scalare”, composto da quattro livelli definitori, che procedono dalla qualifica più ampia fino a quella più ristretta. Tanto più ampia è la definizione, tanto minore è il numero di obblighi applicabili.

Tutti i livelli possiedono un nucleo di obblighi comuni; tuttavia, passando da un livello ad un altro, il livello successivo è destinatario di una normativa ulteriore.

Ad esempio, il secondo livello, ferma la disciplina comune, è soggetto ad obblighi ulteriori rispetto al primo; a propria volta, il terzo livello condivide col secondo e col primo la medesima normativa, ma è destinatario di obblighi non previsti per i livelli precedenti.

4.1. Il primo livello. Servizi di intermediazione

Al primo livello del Digital service act si collocano i servizi di intermediazione. Questi si articolano in:

1) un servizio di semplice trasporto (“mere conduit”), previsto dall’art. 3, che consistente “nel trasmettere, su una rete di comunicazione, informazioni fornite da un destinatario del servizio, o nel fornire accesso a una rete di comunicazione”;

2) un servizio di memorizzazione temporanea (“caching”), disciplinato dall’art. 4, che consiste “nel trasmettere, su una rete di comunicazione, informazioni fornite dal destinatario del servizio, che comporta la memorizzazione automatica, intermedia e temporanea di tali informazioni al solo scopo di rendere più efficiente il successivo inoltro delle informazioni ad altri destinatari su loro richiesta”;

3) Un servizio di “hosting” (art. 5), “consistente nel memorizzare informazioni fornite da un destinatario del servizio su richiesta di quest’ultimo”.

A questi soggetti si applicano le norme relative al Capo II (artt. 3-9)[19], oltre che le norme previste dalla Sezione I del Capo III (artt. 10-13). Tale nucleo normativo è, inoltre, l’insieme di norme applicabile a tutte le figure considerate dal regolamento.

Ai sensi dell’art. 8, le autorità giudiziarie o amministrative nazionali competenti possono inviare richieste di rimozione di determinati contenuti illegali. I prestatori di servizi intermediari informano l’autorità che ha emesso l’ordine, specificando le misure adottate e il momento in cui sono state attuate.

Il Capo III, Sezione I, individua anch’esso una serie di obblighi comuni a tutti i soggetti considerati dal regolamento. Tra questi:

1) vi è l’istituzione, a carico degli intermediari, un “punto di contatto” (art. 10) che consenta la comunicazione diretta, per via elettronica, con le autorità degli Stati membri e la Commissione.

2) si prevede che i prestatori di servizi intermediari includano nelle loro condizioni generali informazioni sulle restrizioni che impongono in relazione all’uso dei loro servizi per quanto riguarda le informazioni fornite dai destinatari del servizio (art. 12).

4.2. Il secondo livello. Servizi di hosting

Il secondo livello ricomprende i prestatori di servizi di hosting. Ad esso è dedicata, in via esclusiva, la Sezione II del capo III (artt. 14-15), ferma restando l’applicazione del Capo II e della Sezione I del Capo III (come già detto, comuni a tutti i livelli).

Il servizio di hosting è sì ricompreso nella generale definizione di “servizi intermediari”, ma è altresì destinatario di norme ulteriori rispetto a quelle applicabili ai servizi ricompresi nel primo livello.

Ai sensi dell’art. 14, i prestatori di servizi di hosting predispongono meccanismi per consentire a qualsiasi persona o ente di notificare loro la presenza nel loro servizio di informazioni specifiche che tale persona o ente ritiene costituiscano contenuti illegali.

In base all’art. 15, il prestatore di servizi di hosting può rimuovere un contenuto o disabilitarne l’accesso. A tal proposito, è tenuto ad informare il destinatario della decisione, fornendo una motivazione chiara e specifica di tale decisione.

Altro obbligo, previsto all’art. 15, p. 4, è quello per il quale i prestatori di servizi di hosting pubblicano le decisioni e le motivazioni di cui al paragrafo 1 in una banca dati pubblicamente accessibile gestita dalla Commissione.

Si faccia ora un breve inciso per dimostrare la richiamata struttura per livelli “a scalare”. Tra i diversi tipi di servizi intermediari solo per l’hosting è ammessa la segnalazione da parte di un privato. Ciò poiché l’art. 14 non si applica agli altri servizi intermediari, per i quali trova applicazione il solo art. 8: quest’ultimo non consente che il singolo cittadino presenti una segnalazione.

4.3. Il terzo livello. Piattaforme online

La Sezione III (artt. 16 -24) è dedicata al terzo livello. Tra le piattaforme di hosting sono individuabili le c.d. “piattaforme online“. Anche in questo caso, il terzo livello “eredita” la normativa applicabile ai livelli precedenti, con aggiunte ulteriori.

Ai sensi dell’art. 2 lett. h), le piattaforme online sono prestatori di servizi di hosting che, su richiesta di un destinatario del servizio, memorizza e diffonde al pubblico informazioni, tranne qualora tale attività sia una funzione minore e puramente accessoria di un altro servizio e, per ragioni oggettive e tecniche, non possa essere utilizzata senza tale altro servizio e a condizione che l’integrazione di tale funzione nell’altro servizio non sia un mezzo per eludere l’applicabilità del presente regolamento.

Le piattaforme online sono tenute (art. 17), in primo luogo, a fornire ai destinatari del servizio, per un periodo di almeno sei mesi dalla decisione, l’accesso a un sistema interno di gestione dei reclami relativo:

- a) alle decisioni di rimuovere le informazioni o disabilitare l’accesso alle stesse;

- b) alle decisioni di sospendere o cessare in tutto o in parte la prestazione del servizio ai destinatari;

- c) alle decisioni di sospendere o cessare l’account dei destinatari.

L’art. 19 istituisce il servizio dei “segnalatori attendibili”. Le piattaforme online devono trattare e decidere tempestivamente le notifiche presentate dai segnalatori attendibili. La qualifica di segnalatore attendibile, a norma del presente regolamento, viene riconosciuta dal coordinatore dei servizi digitali dello Stato membro in cui è stabilito il richiedente.

Si intende così introdurre un sistema semplificato di controllo: se la segnalazione proviene da un soggetto certificato, è ridotto il grado di accertamento che la piattaforma deve svolgere.

L’art. 20 prevede la misura della sospensione del servizio in capo ai soggetti che con frequenza forniscono contenuti manifestamente illegali.

Inoltre, ai sensi dell’art. 21, qualora si sospetti che vi sia una minaccia per la vita o la sicurezza delle persone, la piattaforma online informa senza indugio le autorità giudiziarie o di contrasto dello Stato membro o degli Stati membri interessati in merito ai propri sospetti, fornendo tutte le informazioni pertinenti disponibili.

4.4. Il quarto livello. Piattaforme online di dimensioni molto grandi

Infine, la Sezione IV (artt. 25-33) individua una figura speciale di piattaforma online, quella di “dimensioni molto grandi”. Questa è ricompresa nel quarto e ultimo livello.

In primo luogo, sono piattaforme di dimensioni molto grandi quelle che prestano i loro servizi a un numero medio mensile di destinatari attivi del servizio nell’Unione pari o superiore a 45 milioni (art. 25).

Il regolamento, all’art. 26, pone l’obbligo di valutazione dei rischi sistemici significativi derivanti dal funzionamento e dall’uso dei loro servizi nell’Unione, da adempiere almeno una volta all’anno.

La valutazione dei rischi deve riguardare:

- a) la diffusione di contenuti illegali tramite i loro servizi;

- b) eventuali effetti negativi per l’esercizio dei diritti fondamentali al rispetto della vita privata e familiare e alla libertà di espressione e di informazione, del diritto alla non discriminazione e dei diritti del minore;

- c) la manipolazione intenzionale del servizio.

Sulla scorta di tale analisi, ai sensi dell’art. 27, le piattaforme adottano misure di attenuazione ragionevoli, proporzionate ed efficaci, adattate ai rischi sistemici specifici individuati a norma dell’art. 26.

L’art. 30 si occupa della trasparenza della pubblicità online. Le piattaforme predispongono un registro, il quale comprende il contenuto della pubblicità; la persona fisica o giuridica per conto della quale viene visualizzata la pubblicità; il periodo durante il quale è stata visualizzata la pubblicità; il numero totale di destinatari del servizio raggiunti e, ove opportuno, i dati aggregati relativi al gruppo o ai gruppi di destinatari ai quali la pubblicità era specificamente destinata.

Inoltre, ai sensi dell’art. 31, le piattaforme forniscono al coordinatore dei servizi digitali del luogo di stabilimento o alla Commissione, su loro richiesta motivata, l’accesso ai dati necessari per monitorare e valutare la conformità al presente regolamento.

Le piattaforme nominano, infine, uno o più responsabili della conformità, incaricati di monitorare la conformità di tali piattaforme al regolamento (art. 32)

5. Conclusioni

Ricapitolando la struttura del Digital service act, al primo livello si collocano i servizi di intermediazione, ai quali si applicano le sole norme del Capo II e la Sezione I del Capo III.

Al secondo livello, tra i servizi di intermediazione, si collocano i servizi di hosting. A questi si applica, oltre che le norme previste per i servizi di intermediazione, anche la Sezione II del Capo III.

Al terzo livello sono collocate, tra i servizi di hosting, le piattaforme online; a queste, oltre al Capo II e alle Sez. I e II, si applica anche la sezione III del Capo III.

Infine, all’ultimo livello, tra le piattaforme online, sono individuate le piattaforme di grandi dimensioni. A queste, oltre alle norme comuni alle altre forme di servizi, si applica in via esclusiva la sezione IV del Capo III.

Da tale schema deriva che al soggetto definito in via generale si applicano il minor numero di norme, mentre al soggetto definito in via più specifica si applicano tutte le disposizioni del regolamento.

Si allega un sintetico grafico predisposto dalla stessa Commissione europea[20] che ben individua la struttura a livelli del Digital service act.

1) I servizi di intermediazione offrono le infrastrutture di rete: sono i fornitori di accesso a Internet o registrar di nomi di dominio.

2) Tra i servizi di intermediazione, vi sono i servizi di hosting, quali i servizi cloud e di webhosting.

3) Tra i servizi di hosting vi sono le piattaforme online, che riuniscono venditori e consumatori come: mercati online, app store, piattaforme dell’economia collaborativa e piattaforme dei social media.

4) Le piattaforme online di grandi dimensioni, infine, comportano rischi particolari per la diffusione di contenuti illegali e i danni alla società.

[1] Testo del Digital Service Act al seguente link https://eur-lex.europa.eu/legalcontent/IT/TXT/PDF/?uri=CELEX:52020PC0825&from=it

[2] ‘Hate Speech’ Explained A Toolkit, Edition 2015. Il documento è reperibile presso il seguente link: https://www.article19.org/data/files/medialibrary/38231/’Hate-Speech’-Explained—A-Toolkit-%282015-Edition%29.pdf

[3] Testo della decisione-quadro: https://eur-lex.europa.eu/legal-content/IT/TXT/PDF/ uri=CELEX:32008F0913&from=IT

[4] Qui il testo della direttiva https://eur-lex.europa.eu/legal-content/IT/TXT/HTML/?uri=CELEX:32000L0031&from=ET

[5] Una specifica analisi del contenuto della direttiva verrà compiuta nel secondo contributo dedicato al Digital service act

[6] Federica Casarosa, L’approccio normativo europeo verso il discorso dell’odio online: l’equilibrio fra un sistema di “enforcement” efficiente ed efficace e la tutela della libertà di espressione

[7] C. T. Marsden, Internet co-regulation: European law, regulatory governance, and legitimacy in cyberspace, 2011.

[8] Il codice di condotta è disponibile al seguente link https://ec.europa.eu/commission/presscorner/detail/it/ip_20_1134

[9] Dati liberamente consultabili al seguente link https://ec.europa.eu/commission/presscorner/detail/en/ip_21_5082

[10] I dati della rilevazione del 2020 sono consultabili al seguente link https://ec.europa.eu/commission/presscorner/detail/it/IP_20_1134

[11] Il testo della norma in Gazzetta Ufficiale https://www.gazzettaufficiale.it/eli/id/2017/06/3/17G00085/sg

[12] Qui il testo del D.L. 30 giugno 2003, n. 196

https://www.normattiva.it/uri res/N2Ls?urn:nir:stato:decreto.legislativo:2003-06-30;196!vig

[13] Per un’analisi approfondita, si legga La legge tedesca per il miglioramento dell’applicazione delle norme sulle reti sociali, Servizio studi del Senato, n. 188 – ottobre 2017

[14] EU: New hate speech rules for social networks in the European Union, Dr. Andreas Splittgerber and Caroline Walz on 29 June 2021

[15] Guido Scorza, Odio online, la meravigliosa lezione della Consulta francese sulla libertà di espressione, il FattoQuotidiano, 23 Giugno 2020

[16] Bruno Saetta, Francia, bocciata la legge che obbliga le piattaforme online a rimuovere i contenuti di odio entro un’ora, Valigia Blu, 22 Giugno 2020

[17] Si legga il considerando n. 2 allegato alla proposta di regolamento: “tenendo conto del carattere intrinsecamente transfrontaliero di Internet, tali legislazioni nazionali divergenti incidono negativamente sul mercato”.

[18] Si rinvia alla comunicazione della Commissione, visionabile al seguente link: https://ec.europa.eu/info/strategy/priorities-2019-2024/europe-fit-digital-age/digital-services-act-ensuring-safe-and-accountable-online-environment_it#quali-sono-le-prossime-tappe

[19] Il regolamento individua per ognuno di tali servizi diversi presupposti per una responsabilità diretta da contenuto illecito. Per l’analitica analisi dei presupposti della responsabilità degli intermediari si rinvia al testo del regolamento

[20] Legge sui servizi digitali: garantire un ambiente online sicuro e responsabile, disponibile qui: https://ec.europa.eu/info/strategy/priorities-2019-2024/europe-fit-digital-age/digital-services-act-ensuring-safe-and-accountable-online-environment_it

Sono laureato in Giurisprudenza con votazione 110/110 L. Ho discusso la tesi in Diritto Penale, trattando il tema della persistenza di ipotesi di responsabilità oggettiva all’interno dell’ordinamento nazionale.

Sono abilitato all’esercizio della Professione Forense.